Alig néhány hete egy spanyolországi kisváros azzal került a lapok címlapjára, hogy meztelen fiatal lányok fotói jelentek meg iskolákban. Kiderült, hogy a képeket a mesterséges intelligencia segítségével szerkesztették, az eredeti fotókat – nyilvánvalóan felöltözve – a közösségi oldalaikról lopták le.

Almendralejo öt középiskolájából négyben terjedni kezdtek a képek, és több mint húsz 11 és 17 év közötti lányt azonosítottak a régióban, ami különös aggodalomra ad okot. Ugyanis a Clothoff nevű program, amivel a képeket szerkesztették, bárki számára ingyenesen hozzáférhető.

Felháborodott szülők

A sztori akkor került napvilágra, amikor az egyik érintett lány édesanyja, Mirian Al Adib a közösségi médiában próbálta felhívni a figyelmet a történtekre. Az Instagramra egy videót is kitett, ahol így nyilatkozott:

Amikor hazaértem, a lányom rettenetes undorral azt mondta: »nézd, mit tettek velem«. Készítettek róla egy képet, amin úgy tűnt, mintha meztelen lenne. Megtették vele, és több tucat másik lánnyal is.

Az érintett szülők egy WhatsApp csoportot hoztak létre, hogy támogatást nyújtsanak az áldozatoknak. María Blanco Rayo, egy 14 éves lány édesanyja a BBC News-nak elmondta, hogy a képek jelentős hatással voltak néhány érintettre. Néhányan „el sem hagyják az otthonukat”, tette hozzá szomorúan.

Mirian Al Adib szerint a dolgok nem maradhatnak így, és mindent megtesznek azért, hogy megállítsák ezeknek a fotóknak a terjedését, hiszen akár mesterséges intelligencia generálta, akár nem, ez gyermekpornográfia, és mint ilyen, a vele való visszaélés büntetendő.

A legszomorúbb azonban egészben, hogy a tíz gyanúsított közül néhányan 13 évesek, vagy még fiatalabbak, de a 14 éven aluli gyerekeket Spanyolországban nem lehet büntetőeljárás alá vonni.

Az eset nem egyedi

Nem ez volt az első olyan nemzetközi eset, amikor az MI-vel így visszaéltek. Szeptemberben egy dél-koreai férfit zártak börtönbe azért, mert ugyanilyen módon erotikus tartalmú képeket készített gyerekekről. A férfi a vád szerint egy képgeneráló mesterségesintelligencia-programot használt mintegy 360 szexuális tartalmú fotó létrehozásához. Ugyan nem terjesztette a képeket, de a magatartása jogellenesnek bizonyult, miután olyan szavakat használt az elkészítésükhöz, mint „10 éves”, „meztelen” és „gyerek”. Emellett a bíróság elutasította a védelem azon állítását is, miszerint a fotók nem tekinthetőek szexuális jellegűnek, ugyanis meglehetősen élethűre sikerültek.

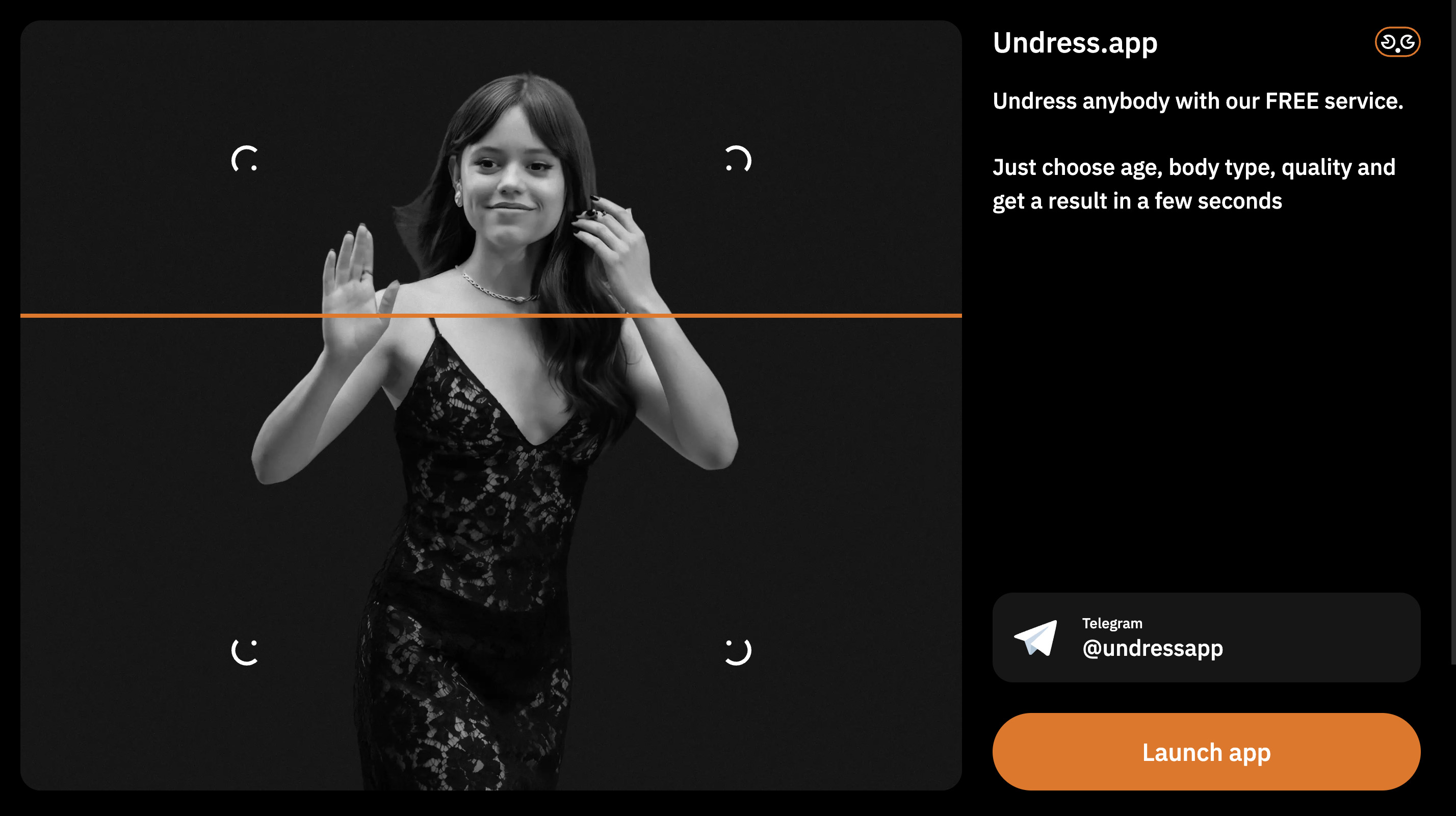

Ez fogad a Clothoff weboldalán

A bíróság úgy ítélte meg, hogy a gyermekek és fiatalok védelméről szóló helyi törvényeket a férfi – akinek egyébként a nevét nem hozták nyilvánosságra – megsértette, ezért 2,5 év börtönbüntetésre ítélték.

Ki lesz a következő?

Nem vagyok édesanya. Kilátásban sincs, hogy az legyek. De ember vagyok, nő vagyok, barátnő és nagynéni vagyok, és szorongással tölt el, ha belegondolok, mi jön ezután? Ki lesz a következő? Valamelyik barátom, szerettem? Netán egy teljesen ismeretlen lány, akit öngyilkosságba hajszol az, hogy ilyen jellegű fotót adnak kézről kézre az iskolatársai? Vagy én? Mert ez bárkivel megtörténhet már a következő percben is, a dolog nem korhoz kötött.

És hol kezdődik a nevelés szerepe? Ott, hogy a lányok összetartanak, és nem tesznek ilyet egymással? Vagy ott, hogy a fiainkat arra tanítjuk, hogy ez egyáltalán nem poén? Hiszen az is probléma, hogy sokan már gyerekkorukban találkoznak a pornóval és irreális elképzelésük van a szexről, aminek köze nincs a valósághoz.

Hogyan lehet ezt megakadályozni? Mit tud tenni a büntetőjog annak érdekében, hogy ne történhessen meg? Hogy felelősségre vonják a tetteseket, akkor is, ha gyerekek? Mert valahol meg kell húzni egy határt, és azt gondolom, hogy egy 13 éves gyerek már tisztában van azzal, hogy minden tett következményt von maga után.

Ha pedig megtörtént, ki fogja az áldozatok kezét? Ki mossa le róluk a szégyent, amit emiatt át kellett élniük? És tényleg, ki lesz a felelős azért, hogyha valaki úgy dönt, nem tud ezzel együtt élni, és eldobja az életét?

Az esetek számomra azt mutatják, hogy a bullying egy olyan új korszakába érkeztünk meg az MI térhódításával, ami azzal együtt, hogy még mindig gyerekcipőben jár, már most rendkívül sok aggályt felvet. Többek között a pedofil visszaéléseket is.

Ragadozók fegyverkezési versenye

A Washington Postnak nyilatkozó elemző a ragadozók fegyverkezési versenyének nevezte azt a jelenséget, amit a generatív MI indított be a pedofil fórumokon. Azt mondja, a sötét weben gyermekpornográf képek ezreit találták már meg, amik így készültek. Nemcsak lemeztelenített képekről van szó, hanem olyanokról is, ahol a gyerekek szexuális aktus közben láthatóak.

Rebecca Portnoff, a Stanford Internet Observatory and Thorn adattudományi igazgatója szerint, ami egy gyermekbiztonságra szakosodott nonprofit szervezet, tavaly ősz óta hatalmasat ugrott a képek elterjedtsége. A legnagyobb probléma az, hogy ezek valóban teljesen élethűek, szinte lehetetlen kiszúrni, hogy nem valóságosak. Ez a központi nyomkövető rendszert is megzavarhatja, aminek feladata, hogy az ilyen anyagokat blokkolja az interneten, az újonnan generált képekre ugyanis nem készítették fel. A jelenség azzal is fenyeget, hogy a bűnüldöző szervek tisztviselői sokkal inkább leterheltek lesznek, hiszen eddig az áldozatok azonosítása valódi gyerekekhez volt köthető, most azonban még azt is ki kell találniuk, hogy akit a képen látnak, valóságos, vagy csak egy MI-generálta személy.

Egy másik „vetkőztető” app hirdetése

Tanulmányuk szerint a szabályozó hatóságok és a bűnüldöző szervek már most is hatalmas mennyiségű képet fésülnek át mindennap, hogy megpróbálják azonosítani az áldozatokat. Ahogy a mesterséges intelligencia által generált képek egyre inkább elterjednek, még nehezebb lesz megállapítani, hogy mely képek tartalmaznak valódi segítségre szoruló áldozatokat. Ráadásul a generatív MI valós emberek vagy valódi gyerekek képmásaira támaszkodik kiindulópontként, ami – ha a képek megtartják ezeket a hasonlóságokat – más jellegű visszaélést jelent.

Rebecca Portnoff szerint megoldást jelenthetne a problémára, ha vízjeleket ágyaznának ezekbe a képekbe, így sokkal egyszerűbb lenne a lekövetésük. Emellett az is hasznos lenne, ha ezek a MI-programok zárt forráskódúak lennének, mert akkor a használatuk vállalati csatornákra korlátozódna, és minden kép rögzíthető, nyomon követhető lenne.

A szabályozás azonban még várat magára, a nyílt forráskódú cégek pedig azzal védekeznek, hogy a zárt forráskód megölné a felhasználók kreativitását, szerintük mindenkinek egyéni felelőssége, hogy ezt hogyan használja. Arra mondjuk kíváncsi lennék, ha bármelyik program CEO-jának a lánya kerülne ilyen helyzetbe (ne legyen így), és az ő meztelen képeivel élnének vissza, még mindig ugyanígy vélekedne-e…